Se você estiver trabalhando com a biblioteca Keras e quiser usar o tensorboard para imprimir seus gráficos de precisão e outras variáveis, a seguir estão as etapas a seguir.

Etapa 1: inicialize a biblioteca de retorno de chamada keras para importar o tensorboard usando o comando abaixo

from keras.callbacks import TensorBoard

Etapa 2: inclua o comando abaixo em seu programa imediatamente antes do comando "model.fit ()".

tensor_board = TensorBoard(log_dir='./Graph', histogram_freq=0, write_graph=True, write_images=True)

Nota: Use "./graph". Ele irá gerar a pasta do gráfico no seu diretório de trabalho atual, evite usar "/ graph".

Etapa 3: inclua o retorno de chamada da Tensorboard em "model.fit ()". A amostra é fornecida abaixo.

model.fit(X_train,y_train, batch_size=batch_size, epochs=nb_epoch, verbose=1, validation_split=0.2,callbacks=[tensor_board])

Etapa 4: Execute o seu código e verifique se a sua pasta gráfica está no seu diretório de trabalho. se os códigos acima funcionarem corretamente, você terá a pasta "Graph" em seu diretório de trabalho.

Etapa 5: Abra o Terminal no seu diretório de trabalho e digite o comando abaixo.

tensorboard --logdir ./Graph

Etapa 6: Agora abra o seu navegador e digite o endereço abaixo.

http://localhost:6006

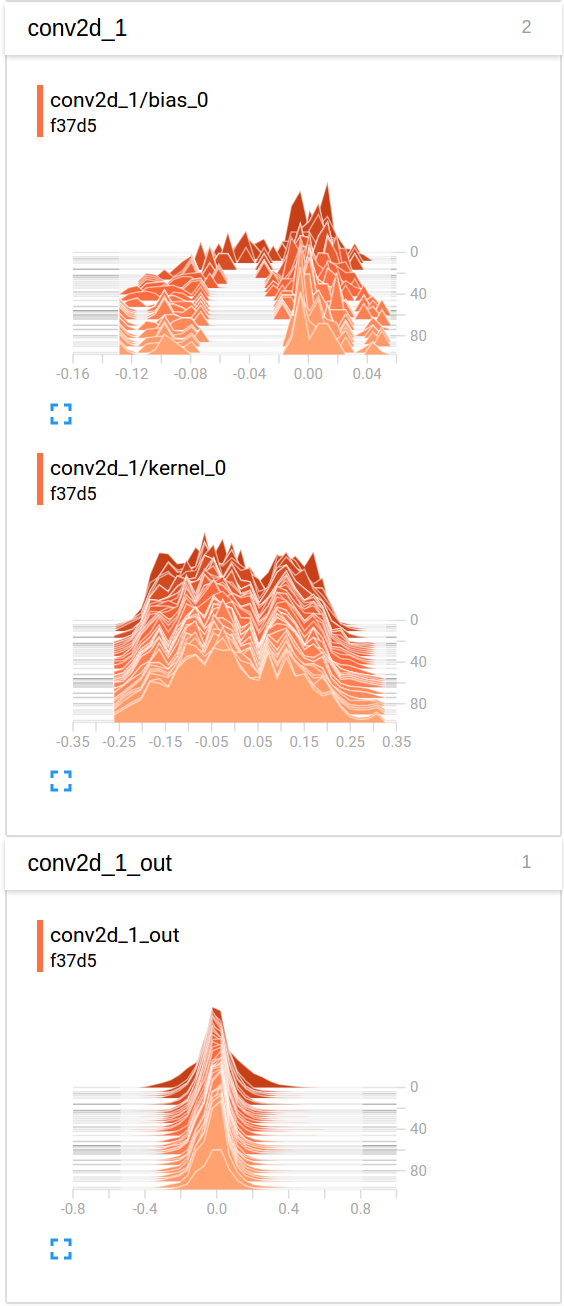

Depois de entrar, a página Tensorbaord será aberta, onde você poderá ver seus gráficos de diferentes variáveis.

histogram_freqcomo1. "histogram_freq: frequência (em épocas) na qual calcular histogramas de ativação para as camadas do modelo. Se definido como 0, os histogramas não serão computados."